亿级流量抗峰指南:高并发系统的三把“破局利刃”

流量来了,你的系统扛得住吗?

对于后端工程师来说,“高并发”这个词无疑是系统设计与面试中最耀眼的皇冠。当一个电商秒杀活动开启的瞬间,或者一篇突围爆火的文章推送到亿万人手机里的一刻,背后考验的绝不仅仅是简单的服务器扩容,而是整套微观到宏观架构层次的防御体系是否牢固。

那么,在动辄百万级 QPS 的冲击下,那些久经沙场的大厂是怎么保证系统不直接“宕机”或者“熔断”的?总而言之,跳过极其复杂的业务细节,最核心的不过是下面这“三板斧”。

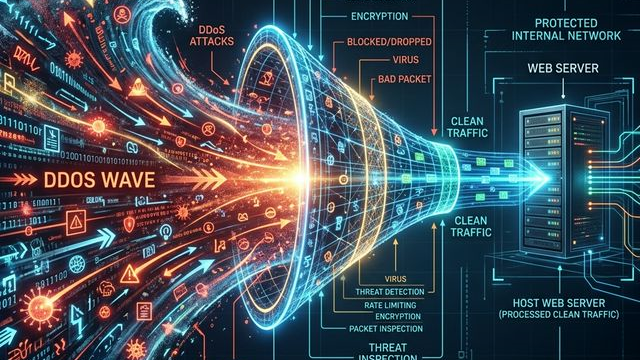

图 1:请求从 CDN、网关到数据库的逐层缩减漏斗模型

利刃一:无处不在的缓存系统 (Caching)

数据库的瓶颈绝不是第一天存在的心病,即使你上再好的 SSD、做再精细的索引优化。因此缓解高频读流量的终极防线在于:尽量不要让大量重复的请求落在持久层。

- CDN 和反向代理: 对于图片、JS 静态资源、甚至是不怎么变动的静态化大屏页面,直接推送至离用户物理距离最近的边缘节点,让流量连核心机房都没有机会踏进。

- 分布式内存缓存(Redis/Memcached): 把大量密集的高频热点数据转储在内存结构中读取,速度和并发量通常能拉升两个数量级以上。

- 多级深层缓存防护: 例如经典的热点穿透、雪崩防控,需要引入布隆过滤器或是通过本地 L1 缓存与 Redis L2 缓存做多层防御网,防止底层被瞬间打穿。

利刃二:化同步为异步 (Asynchronous Processing)

在面对如秒杀下单这样不可控的高峰写流量时,让用户的 HTTP 请求挂起等待服务器写库完毕是不现实且极易全军覆没的。

这种时候,我们需要祭出消息中间件(MQ:Kafka / RabbitMQ / RocketMQ):

“任何可以用作异步解耦的流程,绝不要让它们在线上进行死板串行操作。”

将瞬间激增的 10 万个创建订单请求全部放入消息队列中,然后立即向用户端返回“排队中”。你的系统底层数据库系统可能一秒钟只能扛得住消费 5000 条数据,那没关系,按照它自己的最大学习消化步调慢慢消费即可。MQ 在整个这套系统工程里扮演了一个巨大而安定的“蓄水池与削峰填谷”的关键角色。

图 2:平稳应对瞬间脉冲流量的利器:通过 RabbitMQ 削峰填谷

利刃三:自我保护机制——限流、降级与熔断

系统资源从来都不是无限的。如果我们使用了各种手段还是发现到达性能天花板且系统开始出现各种异常预警时,要毫不留情地开启限流与弃车保帅策略。在云原生微服务中这套体系被称为服务的保护伞。

- 限流(Rate Limiting):采用令牌桶、漏桶等经典算法,如果入口 QPS 大于 1000,硬性直接丢弃或排队多余请求,这是自保的第一防线。

- 降级方案(Degradation):如果系统资源紧张,牺牲掉部分非核心链路(如临时关闭评价显示、为你推荐等边缘渲染模块),去保全主交易链路畅通。

- 链路熔断(Circuit Breaker):类似家里配电箱保险丝的概念。当下游第三方接口发生大面积延迟报错时,快速阻断对其调用,让当前服务迅速“假性失败返回”,而防止请求长期等待导致本服务线程全部阻塞耗尽而宕机。

结语

没有一生下来就能承载亿级用户的完美系统,所有的所谓高并发架构设计,都是伴随着业务发展的泥泞和线上血淋淋的事故,一点点重构演进而来的。学会在这三大原则框架下进行取舍与变通,正是每一个后端资深老兵的独门内功。