从 GPT-4 到 AGI:通用人工智能离我们还有多远?

引言:大模型的狂飙与 AGI 的畅想

自 ChatGPT 开启了 LLM(大语言模型)的狂飙之路以来,“通用人工智能(AGI)”这个曾经只存在于科幻小说和狭窄学术圈的词汇,迅速成为了街头巷尾探讨的热点。

我们正在见证一种前所未有的技术爆炸:从原本只能进行简单对话的模型,进化到具备多模态能力、逻辑推理、甚至初步规划能力的复杂系统。但是,我们距离真正的 AGI 究竟还有多远?

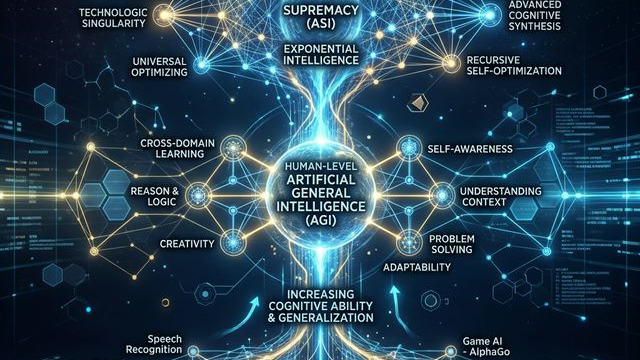

图 1:从弱人工智能到通用人工智能的进化路径图谱

什么是真正的 AGI?

在业界,关于 AGI (Artificial General Intelligence)的定义并没有绝对统一的标准,但共识认为它必须至少满足以下几个条件:

- 跨领域学习与应用能力: 能够像人类一样,在没有特定优化的情况下,跨越几乎所有经济上有价值的工作任务,并达到或超过人类水平。

- 自主推理与多步规划: 面对未知的复杂问题,能够自主拆解任务、制定计划、执行并根据环境反馈自我修正。

- 真正的因果理解: 目前的大模型本质上是基于概率的鹦鹉学舌(尽管学得很像),而 AGI 必须具备理解世界运行因果规律的能力。

通向 AGI 的技术壁垒有哪些?

诚然,目前的 Transformer 架构取得了巨大的成功,但要直接让它演变成 AGI,依然面临着难以逾越的障碍:

1. 数据墙 (Data Wall)

高质量的人类互联网公开数据即将耗尽。如何让模型通过自我对弈(Self-play)或者合成数据(Synthetic Data)持续提升智力,是目前顶级 AI 实验室正在全力攻关的方向。如果突破了这堵墙,AI 进化的速度将不再受限于人类产出数据的速度。

图 2:AI 算力增长与高质量训练数据瓶颈(Data Wall)展示

2. 计算与能源的限制

训练比 GPT-4 大 10 到 100 倍的模型,对算力和能源的消耗将是指数级增长的。正如 Sam Altman 所说,未来 AGI 的竞争本质上是“算力与能源的竞争”。核聚变技术、更高效的芯片架构和底层算法的突破(如不再严重依赖矩阵乘法的替代架构),将决定 AGI 能否从实验室走向现实。

3. 灾难性的遗忘与持续学习

人类可以终身学习而无需“重新训练大脑”,但目前的神经网络很难在不遗忘旧知识的情况下有效学习新知识。实现真正的持续学习(Continual Learning)机制,是通往通用智能的关键一步。

“我们或许不会在某一天突然‘醒来’并宣布 AGI 诞生了,它更可能是一个渐进式突破,逐步融入我们生活每一个角落的过程。”

结语:在奇点前夜

未来的 5 到 10 年,将是人类历史上最激动人心的时期。无论是基于当前多模态大模型的扩展,还是某种我们尚未预见的新型架构的诞生,AGI 的脚步声确切地正在逼近。

作为开发者和技术从业者,我们要做的,不仅是关注技术的狂欢,更要去思考和储备如何在这个新范式下,利用这些前所未有的工具去创造价值。